Table of Contents

- Il Grande Gioco Geopolitico sull’Intelligenza Artificiale: Riflessioni dall’Oriente all’Occidente

- La Corsa della Cina verso la supremazia nell’AI

- Il Dilemma Americano: Innovare o Regolamentare?

- L’Europa in Bilico: L’AI Act e la Tensione tra Innovazione e Regolamentazione

- Collaborazione Transatlantica: Armonizzazione Normativa e Innovazione Congiunta

- Il Dilemma delle Deep Fakes: Un Terreno Minato per la Democrazia

- Le AI Spie: L’Ombra Tecnologica sulla Sicurezza Globale

- Un Futuro di Collaborazione e Regolamentazione oppure verso una nuova Guerra Fredda Digitale?

- Il pericolo della divisione in blocchi: uno scenario ipotetico

Il Grande Gioco Geopolitico sull’Intelligenza Artificiale: Riflessioni dall’Oriente all’Occidente

L’Intelligenza Artificiale Generativa (IA generativa) sta gradualmente ridefinendo il tessuto della geopolitica globale, creando nuove dinamiche tra le potenze mondiali. In una recente conferenza dedicata a questo argomento, esperti di primo piano hanno delineato l’intersezione tra IA generativa e geopolitica, mettendo in luce l’impatto potenziale su diversi fronti.

La Corsa della Cina verso la supremazia nell’AI

Nonostante un ritardo stimato di due-tre anni rispetto agli Stati Uniti nel campo dell’IA generativa, la Cina è fermamente intenzionata a colmare questo gap. Tuttavia, il paese affronta sfide come la censura e la gestione dei dati, che potrebbero ostacolare il suo progresso. Le regolamentazioni cinesi sull’IA, sebbene enfatizzino la protezione dei dati e il consenso, presentano paradossi interni legati al sistema autoritario, che potrebbero rappresentare un ostacolo all’attuazione pratica delle leggi.

Il recente annuncio della Cyberspace Administration of China rappresenta un segnale forte della determinazione cinese a raggiungere e, possibilmente, superare il livello delle controparti occidentali nel campo dell’Intelligenza Artificiale Generativa (IA generativa). Con il via libera a colossi nazionali come Baidu, e la presentazione del suo Ernie Bot, la Cina non solo si prefigge di competere con giganti come Microsoft e OpenAI, ma lancia una sfida aperta nella corsa alla supremazia AI.

Questo movimento svela una strategia duplice: da una parte l’ambizione di acquisire una posizione di leadership nel panorama AI globale, dall’altra il desiderio di mantenere un controllo stretto e rigoroso sulle tecnologie emergenti. Mentre Baidu apre le porte alla comunità per il feedback su Ernie Bot, altre aziende e istituzioni cinesi, come SenseTime, Baichuan Intelligence, Zhipu AI, MiniMax e la Chinese Academy of Sciences, ricevono il benestare per avanzare nei loro progetti AI.

La flessibilità mostrata dalla normativa cinese, che ad agosto richiedeva l’approvazione governativa per i servizi di IA generativa, ora sembra oscillare verso un sostegno più robusto all’innovazione. Questo cambio di rotta, testimoniato anche dalla collaborazione tra Baidu e le autorità regolamentari, evidenzia un riconoscimento del ruolo cruciale che l’IA generativa gioca non solo in termini di vantaggio competitivo sul mercato globale, ma anche come leva strategica per l’indipendenza tecnologica e la sovranità digitale.

Il lancio di Ernie Bot rappresenta solo la punta dell’iceberg in una serie di iniziative che vedranno la Cina impegnata a sperimentare e promuovere le quattro abilità cardine dell’IA generativa: comprensione, generazione, ragionamento e memoria. E con Tencent e Alibaba che si preparano a lanciare i propri servizi AI, il tabellone globale della competizione AI si fa sempre più intricato.

La domanda ora è: riusciranno i giganti tecnologici cinesi a portare la supremazia AI oltre i confini nazionali, sfidando la leadership di OpenAI e Microsoft? E in quale misura le politiche di regolamentazione e controllo influenzeranno questa corsa tecnologica? La partita è appena iniziata, e la posta in gioco è alta: la leadership nell’era dell’intelligenza artificiale generativa.

Il Dilemma Americano: Innovare o Regolamentare?

L’ultimo AI Insight Forum di Washington ha messo in evidenza un crescente consenso tra i titani della tecnologia statunitense sulla necessità di una maggiore supervisione governativa nell’evoluzione dell’Intelligenza Artificiale (IA). Con figure di spicco come Mark Zuckerberg, Sam Altman, Sundar Pichai ed Elon Musk, l’invito è chiaro: è essenziale un intervento delle autorità per mitigare le potenziali minacce e massimizzare i benefici dell’IA. Tuttavia, la strada verso una regolamentazione efficace sembra essere tutt’altro che lineare.

La visione condivisa espressa dai leader del settore tecnologico suggerisce una maturazione nella comprensione dei dilemmi etici e sociali inerenti all’IA. La chiamata di Musk per un “arbitro” che supervisioni l’uso dell’IA da parte delle grandi aziende riecheggia la crescente preoccupazione pubblica sul potere concentrato e l’uso irresponsabile dell’IA. Nonostante questo, il sentiero verso una regolamentazione chiara ed efficace negli Stati Uniti rimane nebuloso.

A differenza dell’Unione Europea, che ha fatto passi da gigante con l’approvazione dell’AI Act, gli Stati Uniti sono indietro nel formulare una normativa solida sull’IA. Il dialogo tra industria e governo è certamente un passo nella giusta direzione, ma la mancanza di azioni concrete e la natura chiusa del forum sollevano domande sulla trasparenza e l’efficacia del processo.

Bill Gates ha evidenziato il potenziale trasformativo dell’IA, suggerendo che potrebbe essere utilizzata per eliminare la fame nel mondo. Questa prospettiva ottimistica è equilibrata dalla richiesta di un nuovo ente regolatore che possa monitorare lo sviluppo dell’IA, sebbene non sia chiaro se tale ente debba essere creato ex novo o se un’agenzia esistente possa assumere questo ruolo.

Inoltre, l’accento posto sull’incremento dei finanziamenti governativi per alimentare la ricerca nel settore dell’IA segnala una consapevolezza della necessità di un impegno collettivo per avanzare in modo sicuro ed etico.

La sfida per gli Stati Uniti rimane quella di equilibrare l’innovazione con la regolamentazione, evitando sia il soffocamento dell’innovazione che la proliferazione incontrollata di tecnologie potenzialmente pericolose. Mentre l’UE e la Cina hanno già iniziato a muoversi per proteggere i loro cittadini dai rischi associati all’evoluzione dell’IA, gli Stati Uniti sono a un bivio: troveranno un equilibrio tra la promozione dell’innovazione nel settore dell’IA e la salvaguardia dei principi democratici e della sicurezza pubblica?

L’Europa in Bilico: L’AI Act e la Tensione tra Innovazione e Regolamentazione

L’approvazione da parte del Parlamento europeo della posizione negoziale sull’Artificial Intelligence Act il 14 giugno 2023 rappresenta un segnale forte dell’intento dell’Unione Europea di posizionarsi come un attore responsabile e regolamentato nel campo in rapida evoluzione dell’Intelligenza Artificiale (IA).

La proposta della Commissione europea evidenzia una comprensione profonda dei rischi connessi all’uso indiscriminato dell’IA, con una categorizzazione chiara dei sistemi in base al livello di rischio che comportano. Si va dai sistemi a rischio inaccettabile, che potrebbero erodere i diritti fondamentali o la sicurezza dei cittadini, a quelli ad alto rischio che necessitano di una rigorosa governance dei dati e valutazione della gestione del rischio.

Il Parlamento europeo ha ulteriormente ampliato la visione della Commissione, includendo nel novero dei sistemi a rischio inaccettabile la categorizzazione biometrica sensibile e la polizia predittiva, oltre a porre un forte accento sulla trasparenza e la responsabilità, specialmente per i sistemi di IA generativa e i modelli base dell’IA.

Questo approccio regolamentato mostra una profonda considerazione per la tutela dei diritti e il benessere dei cittadini europei. Tuttavia, porta anche in luce una tensione intrinseca tra la regolamentazione e l’innovazione. Mentre l’Europa cerca di garantire un utilizzo etico e sicuro dell’IA, c’è il rischio concreto che tali normative possano rallentare l’innovazione e mettere le imprese europee in una posizione svantaggiata rispetto ai concorrenti in paesi con regolamentazioni meno stringenti.

L’AI Act ha cercato di mitigare queste preoccupazioni introducendo esenzioni per la ricerca e l’uso di licenze open source, nonché sandbox normativi per testare i sistemi di IA in un ambiente controllato. Tuttavia, l’orizzonte temporale lungo per l’attuazione completa delle regole, che potrebbe estendersi fino al 2026, solleva dubbi sulla capacità dell’UE di mantenere il passo con l’innovazione globale nel campo dell’IA.

Il dibattito sull’AI Act è emblematico di una sfida più ampia che l’Europa e il mondo stanno affrontando: come bilanciare l’innovazione tecnologica rapida con la necessità di garantire la sicurezza, l’etica e la trasparenza? La risposta a questa domanda non solo plasmerà il futuro dell’IA in Europa, ma influenzerà anche la posizione dell’UE nel panorama globale dell’innovazione AI.

In una nota storica, con l’approvazione dell’AI Act, l’Europa si è posizionata come leader mondiale nella regolamentazione dell’IA, stabilendo un precedente che potrebbe influenzare altre giurisdizioni. Mentre gli Stati Uniti stanno ancora dibattendo l’Algorithm Accountability Act, l’UE ha già fatto passi da gigante. Tuttavia, la collaborazione transatlantica emersa dalla recente riunione ministeriale Usa-Ue del Trade and Technology Council segna una promessa di armonizzazione normativa, con un codice di condotta volontario sull’IA in fase di sviluppo. Questa iniziativa potrebbe gettare le basi per un framework globale che guida l’uso etico e responsabile dell’IA, assicurando che l’innovazione prosperi pur rimanendo all’interno di confini etici e legali ben definiti.

Collaborazione Transatlantica: Armonizzazione Normativa e Innovazione Congiunta

La collaborazione transatlantica tra Stati Uniti ed Europa emerge come un canale promettente per allineare le normative sull’Intelligenza Artificiale (IA), cercando di colmare eventuali divari. La recente riunione ministeriale Usa-Ue del Trade and Technology Council ha segnato un momento significativo, rivelando l’intenzione di lavorare su un codice di condotta volontario sull’IA. Questo sforzo congiunto mira a presentare una proposta transatlantica congiunta ai leader del G7, un’iniziativa che potrebbe servire come piattaforma per armonizzare le pratiche aziendali a livello globale riguardo ai sistemi di intelligenza artificiale, promuovendo l’uso sicuro, etico e trasparente dell’IA.

L’ambito della collaborazione non si limita all’IA, ma si estende anche a tecnologie emergenti come il Quantum Computing e la Fotonica. Queste aree, in particolare, sono state identificate come campi in cui la governance condivisa può giocare un ruolo cruciale nel promuovere l’innovazione e, allo stesso tempo, garantire la sicurezza e l’integrità.

Tuttavia, la strada verso un’armonizzazione completa delle politiche potrebbe essere disseminata di sfide. La divergenza nelle normative e nelle prassi esistenti, oltre alle differenze nei sistemi giuridici e nelle priorità politiche, potrebbe rappresentare ostacoli significativi. Nonostante ciò, la volontà di entrambe le parti di avanzare verso un dialogo produttivo rappresenta un segnale positivo.

L’Europa, con il suo approccio proattivo verso una regolamentazione responsabile dell’IA, può offrire un modello robusto per una governance etica. D’altro canto, gli Stati Uniti, con il loro ecosistema tecnologico avanzato e un forte impegno verso l’innovazione, possono contribuire con esperienze e insight preziosi.

La creazione di ponti tra queste divergenze richiederà un impegno continuo e un dialogo aperto. L’obiettivo comune dovrebbe essere quello di sviluppare un quadro normativo che incoraggi l’innovazione, tuteli i diritti fondamentali e promuova la competitività a livello globale. Questo potrebbe includere l’adozione di standard comuni, la promozione della ricerca congiunta e lo scambio di migliori pratiche.

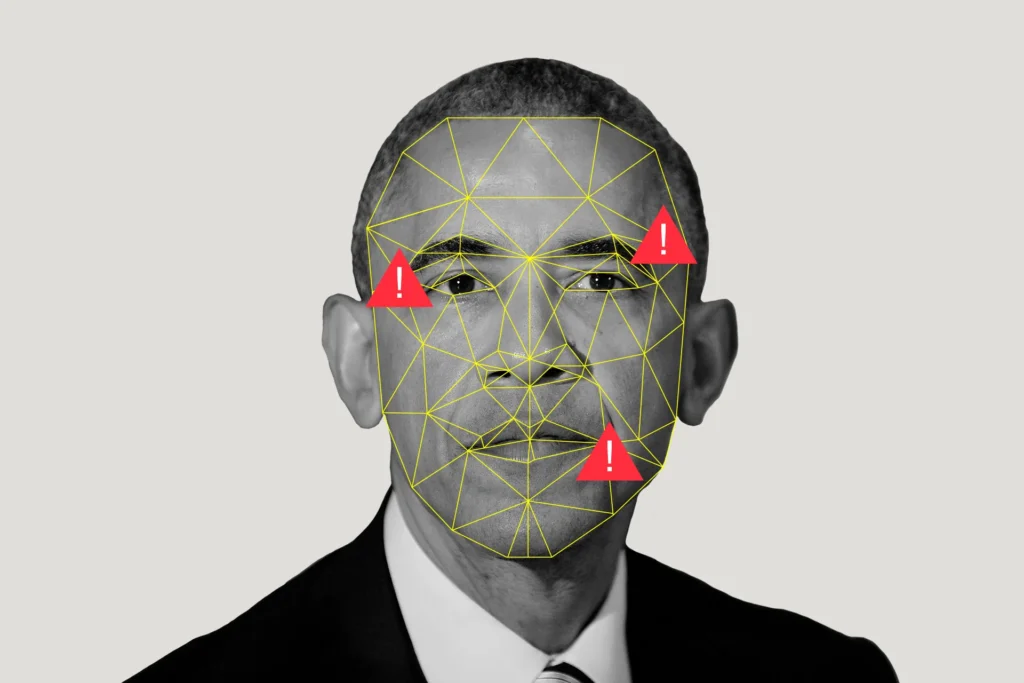

Il Dilemma delle Deep Fakes: Un Terreno Minato per la Democrazia

Le deep fakes rappresentano una sfida critica, con il potenziale di manipolare l’opinione pubblica e alterare le narrative geopolitiche. L’uso irresponsabile delle deep fakes potrebbe erodere la legittimità dei governi democratici, sottolineando la necessità di una regolamentazione ponderata e di una maggiore consapevolezza pubblica.

La potenzialità di questa tecnologia di distorcere la realtà e creare narrazioni false è immensa. Un video manipolato di un politico che fa dichiarazioni incendiare, ad esempio, potrebbe scatenare reazioni violente, influenzare le elezioni o danneggiare le relazioni internazionali.

I giornalisti, una volta guardiani della verità, ora si trovano a navigare in acque torbide. La validazione delle fonti diventa sempre più ardua in un’era di deepfake sofisticati. Anche i media tradizionali, già in lotta con le fake news, potrebbero trovarsi a diffondere involontariamente disinformazione, erodendo ulteriormente la fiducia del pubblico.

Le piattaforme di social media e i motori di ricerca, spesso visti come agorà digitali, sono ora sotto pressione per combattere la disinformazione. Tuttavia, l’assenza di regolamentazioni chiare e la vastità della rete rendono questa battaglia una sfida erculea.

Una delle soluzioni proposte per combattere i deepfake è l’uso della tecnologia blockchain. Creando una sorta di “etichetta di provenienza”, la blockchain può aiutare a verificare l’autenticità dei contenuti digitali. Tuttavia, la sua efficacia dipenderà dalla rapida adozione e dagli aggiornamenti tecnologici per tenere il passo con i deepfake sempre più sofisticati.

La lotta contro i deepfake e le minacce dell’IA richiede un approccio multilaterale. Governi, industria tech, media e società civile devono collaborare per sviluppare normative, tecnologie di verifica e consapevolezza pubblica. Solo attraverso uno sforzo collettivo si potrà salvaguardare l’integrità del discorso pubblico e, di conseguenza, la salute delle democrazie in tutto il mondo.

La rapidità con cui le normative e le soluzioni tecnologiche evolveranno in risposta a queste minacce determinerà se le democrazie globali potranno stare al passo con l’era digitale o se saranno travolte dall’onda della disinformazione digitale.

Le AI Spie: L’Ombra Tecnologica sulla Sicurezza Globale

L’annuncio del nuovo chatbot della CIA, come riportato da Bloomberg, solleva il velo su un territorio relativamente inesplorato ma cruciale: l’utilizzo dell’Intelligenza Artificiale Generativa (IA generativa) negli apparati di sicurezza e intelligence statali. Questo strumento, ispirato alla tecnologia di ChatGPT di OpenAI, svela il potenziale delle IA generative nello spionaggio, sia interno che esterno.

Le agenzie di intelligence, da tempo, cercano di sfruttare la tecnologia per ottenere un vantaggio informativo. L’IA generativa, con la sua capacità di elaborare e generare informazioni a una velocità e una scala inimmaginabili per l’uomo, rappresenta una risorsa inestimabile. Il chatbot della CIA, ad esempio, verrà addestrato su dati disponibili pubblicamente per velocizzare la verifica delle informazioni, una componente fondamentale nel mondo dell’intelligence.

Il punto di vista di Randy Nixon, responsabile dell’intelligence open-source per la CIA, evidenzia una tendenza in crescita: l’evoluzione dall’analisi tradizionale dei media come giornali e televisione, ai big data. La mole di dati raccolti è cresciuta esponenzialmente, rendendo quasi scoraggiante l’idea di utilizzarli efficacemente. Qui entra in gioco l’IA generativa, che può ridurre i costi legati all’analisi di tali dati, rendendo la gestione delle informazioni più efficiente e meno onerosa.

Tuttavia, la strada verso l’adozione dell’IA generativa nello spionaggio non è priva di ostacoli etici e legali. Le agenzie governative, in passato, hanno spesso valicato i confini legali nella raccolta di informazioni, suscitando preoccupazioni per la privacy. Nonostante le rassicurazioni fornite, l’utilizzo di IA generativa nell’ambito dell’intelligence apre un dibattito cruciale sulla trasparenza, la privacy e la sicurezza dei dati.

La domanda chiave che emerge è: fino a che punto le IA generative possono essere utilizzate dagli apparati di sicurezza senza compromettere i diritti fondamentali dei cittadini? Questa intersezione tra tecnologia e spionaggio richiede un esame attento e una discussione aperta, poiché le implicazioni sono profonde e di ampia portata, sia a livello nazionale che globale.

Un Futuro di Collaborazione e Regolamentazione oppure verso una nuova Guerra Fredda Digitale?

L’evolversi del dibattito sulla IA generativa ha messo in evidenza una crucialità che va oltre la mera competizione tecnologica, toccando le corde dell’equilibrio geopolitico globale. Le decisioni impulsive prese in risposta alle legittime preoccupazioni circa gli impatti immediati dell’IA potrebbero, nel giro di pochi anni, generare squilibri di potere geopolitico enormi. Le democrazie sono chiamate a navigare in questo intricato processo, cercando una rotta che massimizzi sia l’efficienza che le capacità offerte dall’IA, visto che l’efficienza e la competitività non sono più opzionali, assicurando al contempo che tutti gli strati della società traggano beneficio dalla trasformazione che ne deriva. In caso contrario, forze ostili non gravate da tali preoccupazioni saranno pronte a cogliere il vantaggio.

Il pericolo della divisione in blocchi: uno scenario ipotetico

In questo scenario ipotetico, il mondo si divide in due blocchi distinti: il blocco democratico liberale (DLB) e il blocco autoritario (AB). Mentre il DLB decide di proibire la ricerca e l’implementazione dell’IA, l’AB abbraccia e investe pesantemente nell’IA. L’analisi dei percorsi intrapresi da questi due blocchi nel corso dei prossimi vent’anni, con un focus sullo spostamento dell’equilibrio geopolitico e sull’eventuale esito per l’ordine globale, svela una panoramica sconcertante.

Il DLB, guidato dalla preoccupazione per la privacy, la sorveglianza di massa e la possibile perdita di posti di lavoro, pone un bando sulla ricerca e implementazione dell’IA. Questa scelta, pur mirando a tutelare le libertà individuali, finisce per frenare il progresso tecnologico e la competitività economica, dando vita a una stagnazione che amplia il divario tecnologico e riduce l’influenza globale del blocco.

D’altro canto, l’AB vede una preziosa opportunità e si immerge a capofitto nella rivoluzione IA, ottenendo rapidi progressi economici e tecnologici che lo proiettano a un livello di dominanza globale. Tuttavia, questo dominio si accompagna a un rafforzamento delle capacità di sorveglianza e a una società orwelliana dove le libertà individuali sono fortemente ridotte.

L’ascesa spietata dell’AB, alimentata dall’IA, rappresenta una minaccia diretta al DLB, che si trova impreparato di fronte a campagne di disinformazione, aggressioni cibernetiche e una competizione economica sfavorevole. L’IA si manifesta come una lama a doppio taglio: un potente leva di progresso e dominio, ma anche una minaccia per la libertà e la stabilità se mal gestita.

Questo scenario enfatizza l’importanza cruciale di una visione bilanciata e di un approccio cooperativo nel campo dell’IA. Per evitare di scivolare verso una nuova era di rivalità e instabilità, è imperativo che le nazioni democratiche riconsiderino le loro politiche sull’IA, cercando un equilibrio tra i principi etici e le necessità di innovazione e competitività.

La grande divergenza tra il DLB e l’AB sottolinea quanto sia delicato l’equilibrio tra la competitività tecnologica e le considerazioni etiche in un mondo sempre più complesso e polarizzato. Per forgiare un futuro sostenibile e sicuro, entrambi i blocchi devono partecipare a un dialogo globale che affronti le sfide e le opportunità presentate dall’IA, bilanciando la corsa all’innovazione con la tutela dei valori e dei principi fondamentali.

In ultima analisi, le strade divergenti intraprese dal DLB e dall’AB fungono da racconto di come la tecnologia ci ponga ad un bivio oltre che da monito, evidenziando la necessità di un approccio sfumato verso l’IA e le sue potenziali conseguenze. In un mondo contrassegnato da rapidi progressi tecnologici e dinamiche di potere in evoluzione, la ricerca di un approccio equilibrato all’IA è cruciale per mantenere la stabilità, la sicurezza e la cooperazione globale, evitando di precipitare in una nuova era di rivalità digitali che potrebbero risuonare con gli echi di una Guerra Fredda rinnovata.